Conecte um Modelo de Linguagem Grande (LLM) com o NeuralSeek

Melhore sua experiência com o NeuralSeek seguindo essas instruções para adicionar de forma transparente pelo menos um LLM (Modelo de Linguagem Grande) para otimizar suas funcionalidades. Se você adicionar mais de um, o NeuralSeek irá equilibrá-los para funções que podem usar vários LLMs. Se um LLM não puder lidar com certos recursos, esses recursos não estarão disponíveis. Se você não adicionar um LLM para uma função, essa parte do NeuralSeek não funcionará.

⚠ Para configurar um LLM, certifique-se de ter se inscrito no plano Bring Your Own LLM (BYOLLM). Todos os outros planos usarão o LLM selecionado pelo NeuralSeek e essa opção não estará disponível. Lembre-se de que é responsabilidade de cada participante entender e gerenciar os custos associados ao uso do NeuralSeek e de quaisquer outros serviços integrados dentro de seu ambiente AWS.

Adicionar um LLM

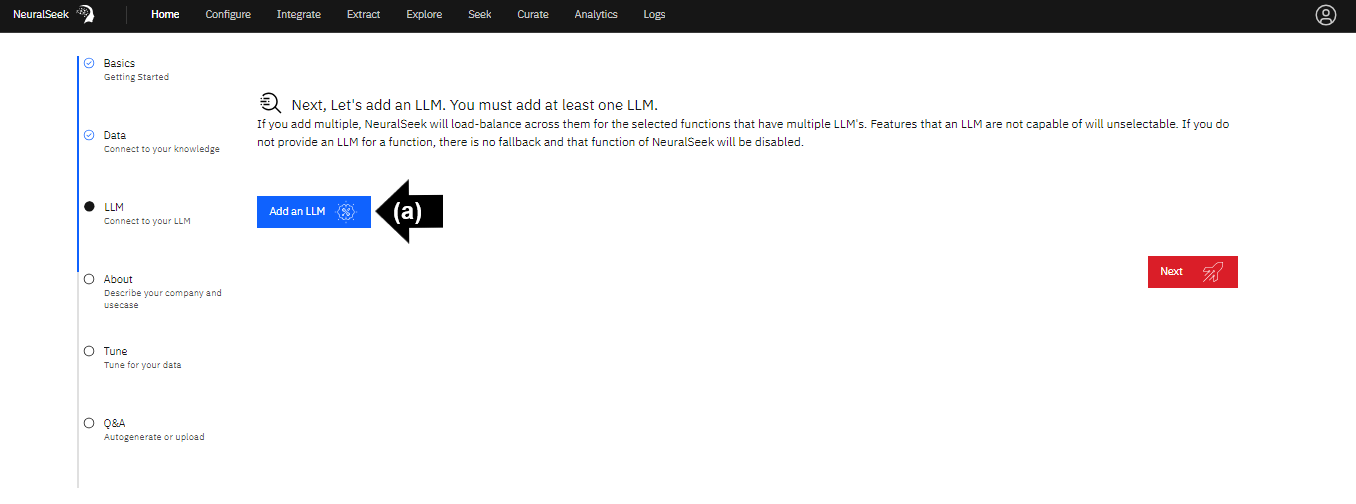

Navegue até a interface do usuário do NeuralSeek.

Na guia Home, siga as etapas para se conectar ao seu LLM.

⚠️ Você deve adicionar pelo menos um LLM.

- (a) Clique em Adicionar um LLM.

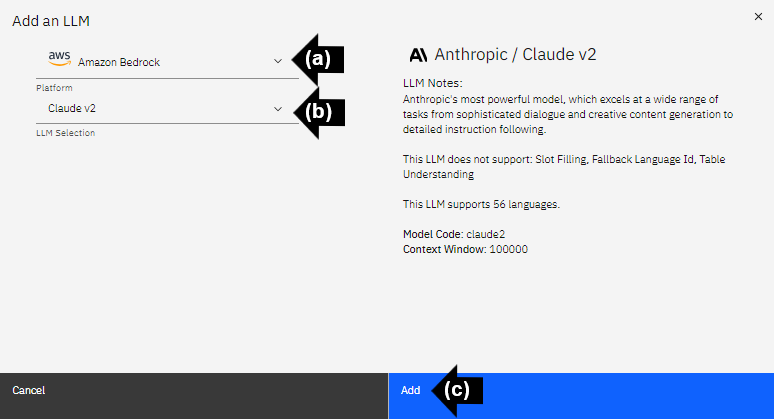

Plataforma e Seleção de LLM

Para usuários da Amazon Web Services (AWS), recomenda-se conectar à plataforma Amazon Bedrock e selecionar o LLM Claude v2.

- (a) Clique no menu suspenso para selecionar a plataforma LLM. Neste exemplo, selecione Amazon Bedrock.

- (b) Clique no menu suspenso para selecionar o LLM. Neste exemplo, selecione Claude v2.

- (c) Clique em Adicionar para adicionar o LLM.

Funções do LLM

Instruções para geração e localização das informações da Chave de Acesso da AWS podem ser encontradas no guia Informações Adicionais da AWS do laboratório.

- Insira a Chave de Acesso da Função da AWS do Amazon Bedrock.

- Insira a Chave de Acesso Secreta da Função da AWS do Amazon Bedrock.

- Insira a Região da AWS do Amazon Bedrock.

- Habilite os idiomas disponíveis do LLM. O NeuralSeek irá habilitar por padrão todos os 56 idiomas disponíveis.

- Selecione as funções desejadas do LLM. O NeuralSeek irá selecionar por padrão todas as funções disponíveis. Para o propósito deste laboratório, selecione as seguintes: Detecção de Informações de Identificação Pessoal (PII), Geração de Conversação, Extração de Entidade, Categorização, Geração de Exemplo, Criação de Intenção, Tradução, Sentimento de Reserva, e Exploração.

Testar o LLM

- Clique em Testar para testar o LLM.

Um Modelo de Linguagem Grande está agora conectado ao NeuralSeek.

⚠️ Os LLMs podem variar em suas capacidades e desempenhos. Alguns LLMs podem levar até 30 segundos ou mais para gerar uma resposta completa. Tenha cuidado ao usar em conjunto com uma plataforma de agente virtual que impõe um limite de tempo rigoroso.